Start maken?

Claude AI in depth: maart 2026

.png)

Veel mensen kennen Claude nog vooral als “dat alternatief voor ChatGPT”. Dat doet het platform inmiddels tekort. Claude is niet meer alleen een chatbot. Het is uitgegroeid tot een breed AI-platform voor kenniswerk, softwareontwikkeling, agentic workflows, documentcreatie, browserinteractie en steeds meer enterprise use cases. Anthropic positioneert Claude vandaag nadrukkelijk als een systeem voor coding, agents en professional work, met onder meer Claude Opus 4.6, Claude Sonnet 4.6, Claude Code, Skills, MCP, Chrome-integratie, documenttools en een securitypropositie die veel verder gaat dan alleen “we hebben een veilig model”.

Dat is precies waarom de hype rond Claude op dit moment zo sterk is. Anthropic koppelt sterke modelkwaliteit aan een veiligheidsverhaal dat veel organisaties aantrekkelijk vinden, maar het blijft niet bij positionering alleen. Het bedrijf heeft in korte tijd Claude Code uitgebouwd, MCP als open standaard breed in de markt gezet, nieuwe agentische functies toegevoegd en Claude Security gelanceerd als research preview voor verdedigers. Tegelijk haalde Anthropic in februari 2026 nog eens 30 miljard dollar op tegen een waardering van 380 miljard dollar, wat laat zien hoeveel vertrouwen de markt heeft in de enterprise-richting van het bedrijf.

Voor ons is Claude daarom interessant om twee redenen. Ten eerste omdat het technologisch echt een van de meest serieuze platformen van dit moment is. Ten tweede omdat het precies de vragen oproept waar organisaties nu mee worstelen: hoe gebruik je dit veilig, hoe voorkom je shadow AI, hoe maak je van losse experimenten een beheersbare capability, en hoe zorg je dat medewerkers niet in hun eigen tools bedrijfsdata gaan plakken zonder centrale regie? Die vragen raken direct aan AI governance, identity, data controls en security operations, dus precies aan het speelveld waar wij met klanten dagelijks mee bezig zijn.

Wat is Claude eigenlijk?

Anthropic beschrijft Claude als een “highly performant, trustworthy, and intelligent AI platform” dat sterk is in taal, redeneren, analyse, coding en meer. Belangrijk daarbij is dat Claude geen enkel model is, maar een familie van modellen en producten. In de actuele modelstack positioneert Anthropic Claude Opus 4.6 als het meest intelligente model voor agents en coding, Claude Sonnet 4.6 als de beste combinatie van snelheid en intelligentie, en Claude Haiku 4.5 als de snelste variant met near-frontier intelligence. Alle huidige modellen ondersteunen tekst en beeld als input, tekst als output, vision, meertaligheid en deployment via de Claude API, AWS Bedrock en Google Vertex AI.

Die laatste zin is belangrijker dan hij lijkt. Claude is dus niet alleen “de chat op claude.ai”. Het is tegelijk:

- een consumenten- en werkapp,

- een API-platform,

- een coding-agent,

- een document- en workflowlaag,

- en een bouwsteen voor enterprise agents in eigen omgevingen.

Daarmee is Claude voor veel organisaties relevanter dan een klassieke chatbot. Het past niet alleen in communicatie of content, maar ook in engineering, operations, governance, security en kenniswerk.

Wat is Anthropic?

Anthropic is een AI safety- en researchbedrijf en opereert als Public Benefit Corporation. Het bedrijf zegt expliciet te werken aan betrouwbare, interpreteerbare en stuurbare AI-systemen. In de governance-structuur zijn Dario Amodei en Daniela Amodei prominente bestuursleden, en Anthropic koppelt zijn bedrijfsmodel bewust aan verantwoord ontwikkelen en inzetten van geavanceerde AI. Het bedrijf publiceert bovendien een Responsible Scaling Policy, een Transparency Hub en een eigen “Constitution” voor Claude, wat goed laat zien dat Anthropic veiligheid en bestuurbaarheid als onderscheidend onderdeel van zijn merk inzet.

Dat veiligheidsprofiel is niet alleen marketing. Anthropic heeft onder meer ISO 27001, ISO 42001, SOC 2 Type I en Type II, en een HIPAA-ready configuratie voor commerciële producten. In het Trust Center zijn die compliance-artifacts publiek vindbaar. Voor organisaties in gereguleerde of kritieke omgevingen is dat relevant, omdat het laat zien dat Anthropic niet alleen een snelgroeiende AI-speler is, maar ook serieus investeert in governance en assurance.

Waarom is er zoveel hype rond Claude?

De hype rond Claude komt niet uit één hoek. Wij zien vijf aanjagers.

De eerste is modelkwaliteit. Anthropic positioneert Sonnet 4.6 als een brede upgrade op coding, computer use, long-context reasoning, agent planning, knowledge work en design. Opus 4.6 wordt neergezet als de topvariant voor de zwaarste taken. Voor developers en kenniswerkers is dat een heel aantrekkelijk profiel, omdat het niet alleen gaat om losse antwoorden, maar om langlopende, contextzware taken.

De tweede is context. Sonnet 4.6 en Opus 4.6 ondersteunen een context window tot 1 miljoen tokens in beta. Dat maakt Claude interessant voor werk waarbij je grote documentverzamelingen, volledige codebases, lange contracten, auditdossiers of onderzoeksarchieven wilt laten analyseren zonder alles steeds opnieuw te moeten knippen en plakken.

De derde is agentic execution. Anthropic heeft Claude de afgelopen periode steeds nadrukkelijker uitgebouwd van chat naar uitvoering: computer use, browsergebruik, Claude Code, subagents, agent teams, Skills, hooks en MCP. Dat betekent dat Claude niet alleen iets kan uitleggen, maar ook tools kan aanroepen, workflows kan volgen en in bepaalde contexten echt werk kan verrichten.

De vierde is standaardisatie. MCP, het Model Context Protocol, is door Anthropic als open standaard neergezet om AI-applicaties aan tools, data en workflows te koppelen. Anthropic noemt MCP zelf een soort USB-C-poort voor AI-applicaties. In januari schreef het bedrijf bovendien dat MCP inmiddels 100 miljoen maandelijkse downloads had bereikt. Dat is belangrijk, omdat enterprise adoptie niet alleen draait om modelkracht, maar juist om hoe goed AI op een beheerste manier met je bestaande landschap integreert.

De vijfde is geloofwaardigheid in security en enterprise. Claude Code Security, de samenwerking met Mozilla op Firefox-kwetsbaarheden, de compliancepositie van Anthropic en de samenwerking met partijen als Infosys en Microsoft maken duidelijk dat Claude niet meer alleen een tool voor enthusiasts is. Anthropic bouwt heel bewust richting grote organisaties.

Waaruit bestaat Claude in de praktijk?

Wie Claude goed wil begrijpen, moet het platform niet zien als één scherm, maar als een stapel capabilities.

1. De modellen

De actuele kern bestaat uit Opus 4.6, Sonnet 4.6 en Haiku 4.5. Opus 4.6 is bedoeld voor de zwaarste reasoning- en codingtaken. Sonnet 4.6 is de allround enterprise-werkpaardvariant. Haiku 4.5 is de snelle, lichtere optie. Alle drie ondersteunen text + image input, vision en meertaligheid. Opus en Sonnet hebben ook extended thinking en een 1M token context window in beta.

2. Claude.ai, desktop en mobile

Voor eindgebruikers is Claude beschikbaar via web, desktop en mobiel. Binnen die omgeving zijn functies als Projects, Artifacts, file creation, Skills, chat search, memory en connectors beschikbaar, afhankelijk van plan en feature rollout. Projects maken het mogelijk om gesprekken, kennis en instructies rondom een onderwerp te bundelen. Artifacts geven een aparte werkruimte voor code, documenten, diagrams en interactieve output. Chat search en memory zorgen ervoor dat Claude context uit eerdere gesprekken kan terughalen.

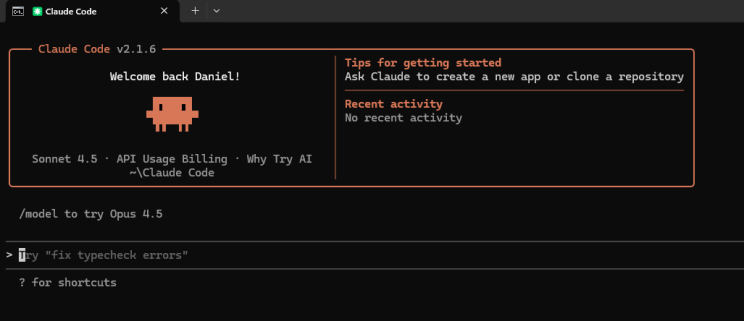

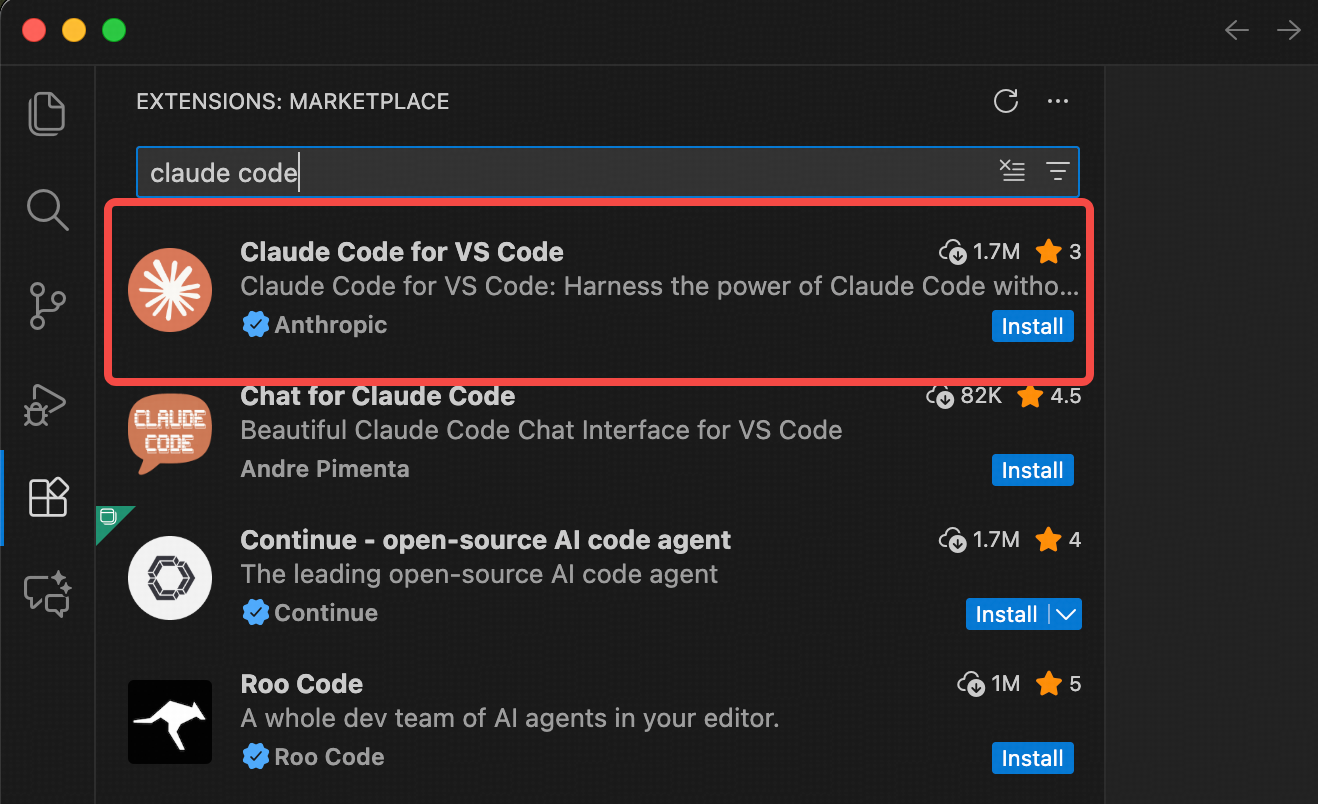

3. Claude Code

Claude Code is de coding- en terminallaag van Anthropic. Anthropic omschrijft het als een agentic coding tool die je codebase kan lezen, files kan bewerken, commando’s kan draaien en kan integreren met development tools. Het is beschikbaar in terminal, IDE, desktop en browser, met integraties voor onder meer VS Code, JetBrains, Slack en CI/CD via GitHub Actions en GitLab. Je kunt Claude Code bovendien gebruiken via Anthropic zelf of via cloudplatformen zoals Amazon Bedrock, Google Vertex AI en Microsoft Foundry.

4. Tools en tool use

Claude ondersteunt tool use, of function calling. Dat betekent dat je Claude niet alleen laat genereren, maar het ook gecontroleerd externe functies kunt laten aanroepen. In de documentatie noemt Anthropic tool access een van de hoogste leverage primitives voor agents. Claude ondersteunt onder meer web search, web fetch, code execution, memory, bash, computer use en text editing. Voor developers is dit het moment waarop Claude verandert van assistant naar operator.

5. Computer use

Computer use is een beta-feature waarmee developers Claude computers kunnen laten bedienen zoals mensen dat doen: scherm interpreteren, cursor bewegen, klikken en typen. Anthropic zegt expliciet dat dit alleen beschikbaar is voor commerciële klanten via de API en door developers moet worden gebouwd en ingeschakeld. Dit is dus geen “grappige desktoptruc”, maar een serieuze capability voor agentische automatisering.

6. Connectors en MCP

Hier wordt het nerdy, maar ook interessant. Connectors zijn de praktische koppelingen waarmee Claude bij data en tools kan. Anthropic heeft een Connectors directory met pre-built connectors en custom connectors via remote MCP. Op Team en Enterprise-plannen moet een Owner of Primary Owner connectors eerst op organisatieniveau activeren voordat gebruikers ze zelf kunnen authen. Voor Google Workspace geldt bijvoorbeeld dat Claude dan alleen toegang krijgt tot de Gmail-, Calendar- en Drive-data van het account dat de gebruiker zelf heeft gekoppeld.

MCP, het Model Context Protocol, is daarbij de open standaard onder de motorkap. Het is gemaakt om AI-applicaties te verbinden met data sources, tools en workflows. Denk aan databases, search, files, API’s en specialistische prompts. Anthropic heeft dit protocol niet alleen bedacht, maar inmiddels ook diep in Claude en Claude Code verweven. Voor organisaties is dit relevant, omdat MCP waarschijnlijk een van de standaarden wordt waarmee AI-agents straks in enterprise-omgevingen opereren.

7. Skills

Skills zijn modulaire uitbreidingen die Claude gespecialiseerde kennis en workflows geven. Anthropic Skills kunnen bijvoorbeeld helpen met Excel, Word, PowerPoint en PDF. Daarnaast kun je eigen custom Skills bouwen, of partner Skills gebruiken die samenwerken met MCP-connectors van bijvoorbeeld Notion, Figma en Atlassian. In Claude Code bestaan Skills uit een SKILL.md met instructies, metadata en optionele resources. Claude gebruikt ze automatisch wanneer relevant, of je roept ze direct aan.

8. Subagents, agent teams, hooks

Dit is het deel waar Claude echt van “tool” naar “systeem” schuift. Anthropic documenteert custom subagents voor taak-specifieke workflows en contextmanagement. Daarnaast introduceerde het in Claude Code agent teams als research preview, waarbij meerdere agents parallel aan delen van een taak werken. Hooks vormen weer de deterministische laag: shellcommando’s die op specifieke punten in de lifecycle draaien, bijvoorbeeld om code automatisch te formatteren, protected files te blokkeren, projectregels af te dwingen of configuratiewijzigingen te auditen. Dit is cruciaal, omdat je hiermee AI-gedrag niet alleen aan prompting overlaat, maar ook afdwingbare regels en automatiseringen toevoegt.

Wat kun je er als organisatie concreet mee?

Dat hangt vooral af van je rol.

Voor iemand zonder programmeerachtergrond is Claude al bruikbaar als denkpartner, documentassistent en creatieve productiviteitslaag. Je kunt documenten laten samenvatten, beleidsteksten laten herschrijven, presentaties en spreadsheets laten genereren, e-mails laten opstellen, een eerste businesscase laten uitwerken of een prototype laten maken via Artifacts, zelfs zonder code te schrijven. Anthropic positioneert Artifacts expliciet als manier om apps, documenten en interactieve output direct uit gesprekken te laten ontstaan, ook voor niet-ontwikkelaars.

Voor een IT-manager zit de waarde eerder in analyse, versnelling en structurering. Denk aan:

- change impact analyses op grote sets documentatie,

- eerste concepten voor beleid en standaarden,

- architectuurnotities,

- samenvattingen van incident- of auditbevindingen,

- versneld vergelijken van vendor-documentatie,

- of het bouwen van interne copilots die op een gecontroleerde manier bij kennisbronnen kunnen.

Dat soort use cases is precies waar Claude’s long-context en tool use sterk zijn.

Voor een engineer of securityteam gaat het nog verder. Claude Code kan codebases lezen, voorstellen doen, edits voorbereiden, tests draaien en zich in IDE’s en CI/CD-flows nestelen. Claude Code Security voegt daar kwetsbaarhedenscans en patchsuggesties aan toe. Mozilla rapporteerde dat Claude Opus 4.6 in februari 2026 22 Firefox-kwetsbaarheden vond, meer dan er in enig maandpunt van 2025 uit alle bronnen samen waren gerapporteerd. Dat maakt Claude opeens niet alleen een developer-assistent, maar potentieel ook een force multiplier voor AppSec en secure development.

Wat maakt Claude anders dan ChatGPT, Gemini, Copilot en Perplexity?

Het eerlijke antwoord is: geen enkel platform “wint” alles. Het hangt af van je context.

ChatGPT is op dit moment heel sterk in breed consumentengebruik, ecosystemen, agent mode en workspaces zoals Projects. OpenAI heeft bovendien veel momentum in apps, connectors en business integrations. Claude voelt daarentegen vaak sterker wanneer het gaat om codebasewerk, lange context, agentische bouwblokken en een relatief open benadering van tool- en data-integratie via MCP. OpenAI leunt op Apps & Connectors en Agent Mode, Anthropic op MCP, Skills en Claude Code als fundament.

Gemini is logischer wanneer een organisatie diep in Google Workspace zit. Google positioneert Gemini sterk in Gmail, Docs, Sheets, Slides, Drive en Deep Research. Claude kan ook met Google Workspace-data werken via connectors, maar Gemini heeft daar vanzelfsprekend de meest native positie. Claude wordt interessanter wanneer je juist een platform zoekt dat naast je stack kan staan en relatief model- en tool-agnostisch richting workflows beweegt.

Copilot is voor veel Microsoft-organisaties de natuurlijke eerste stap, juist omdat het ingebed zit in Microsoft 365, Entra en de bestaande werkcontext. Microsoft zet nu zwaar in op Copilot Cowork, Work IQ en Agent 365. Opvallend is dat Microsoft daarbij expliciet zegt Claude Cowork-technologie te gebruiken in Microsoft 365 Copilot. Dat laat zien hoe serieus Anthropic technisch wordt genomen, ook door andere platformspelers.

Perplexity blijft weer sterker als research- en answer-engine-omgeving. Voor snelle informatieverzameling, brongebaseerde synthese en web-first workflows is dat een logische keuze. Claude is meer een operator voor denken, bouwen en integreren.

Onze samenvatting zou zijn: Claude is vooral interessant als je iets zoekt dat tegelijk sterk is in lange context, coding, agentische bouwstenen en enterprise governance-potentie.

Hoe gebruik je Claude veilig?

Dit is het deel waar veel organisaties de fout ingaan. De neiging is groot om medewerkers gewoon te laten experimenteren. Zeker als er een weekend aankomt waarin veel mensen thuis eens lekker willen knutselen met nieuwe AI-tools. Daar is op zichzelf niets mis mee, zolang je maar begrijpt dat “lekker uitproberen” in een zakelijke context vaak heel snel leidt tot shadow AI.

Bij Claude is dat extra relevant omdat individuele accounts en organisatie-accounts gescheiden werelden zijn. Anthropic zegt expliciet dat Free, Pro en Max aparte accounttypes zijn ten opzichte van Team en Enterprise, en dat individuele accounts niet simpelweg naar een Team- of Enterprise-organisatie kunnen worden gemigreerd. Als medewerkers dus op eigen houtje processen, prompts, projecten en connectoren gaan opbouwen in persoonlijke omgevingen, krijg je later governance- en migratiefrictie.

Daarom zouden wij altijd met een paar basisregels beginnen.

De eerste: bepaal centraal welk type Claude-gebruik je toestaat. Is het alleen chat en samenvatten? Mag men files genereren? Mogen er connectors aan? Mag Claude schrijven of alleen lezen? Mag Claude Code in repositories? Mag computer use in productieomgevingen? Zonder die indeling krijg je gegarandeerd wildgroei.

De tweede: maak onderscheid tussen consumenten- en commerciële inzet. Voor commerciële Anthropic-producten, zoals Claude for Work en de API, geldt standaard dat inputs en outputs niet voor modeltraining worden gebruikt, tenzij je expliciet opt-in geeft. Dat is een belangrijk verschil met “ik gebruik thuis even een losse AI-tool”. Voor MCP-data zegt Anthropic bovendien dat Team- en Enterprise-data niet voor training worden gebruikt.

De derde: gebruik enterprise controls waar mogelijk. Anthropic documenteert voor Enterprise onder meer SSO/auth-beheer, audit logs, data retention controls, de Compliance API, IP allowlisting en tenant restrictions. Rollen en permissions bepalen bovendien wie bijvoorbeeld SSO, audit logs en retention mag beheren. Als je Claude serieus als werkplatform wilt gebruiken, moet je dit soort controls ook echt activeren.

De vierde: let op de dataflow van connectors. Voor Google Workspace-connectors zegt Anthropic dat connector-data op Anthropic-servers wordt opgeslagen en met de bijbehorende chat wordt bewaard, en dat je die retrieved data verwijdert door de chat te verwijderen. Ook zegt Anthropic dat het Gmail- en Calendar-connectordata niet gebruikt om modellen te trainen. Dat zijn precies de details die je wilt kennen voordat je medewerkers zomaar mailboxen of kalenders laat koppelen.

De vijfde: kijk goed naar uitzonderingen. Een heel concreet voorbeeld is Claude in Excel. Anthropic zegt zelf dat deze feature momenteel geen observability en auditability heeft, niet in Enterprise audit logs of de Compliance API zit, en ook geen custom retentioninstellingen van je organisatie erft. Dat is geen reden om het nooit te gebruiken, maar wel een uitstekend voorbeeld van waarom governance nodig is: niet elke handige feature is meteen enterprise-ready.

De zesde: behandel MCP-servers, plugins en custom connectors als supply chain. Anthropic waarschuwt expliciet dat third-party MCP-servers niet door Anthropic zijn geverifieerd en dat je extra voorzichtig moet zijn met servers die onbetrouwbare content ophalen, omdat die prompt injection kunnen blootstellen. In de Connectors FAQ raadt Anthropic bovendien OAuth aan boven IP allowlisting. Met andere woorden: connectoren zijn geen onschuldig vinkje, maar een nieuwe attack surface.

De zevende: gebruik permission controls en deterministische guardrails. In Claude Code is read-only de default. Extra acties zoals edits, tests of commando’s vragen expliciete toestemming. Daarnaast kun je deny rules, allow rules, callbacks en hooks gebruiken om gedrag af te dwingen. Voor ons is dit een van de interessantste eigenschappen van Claude: het biedt echte mechanieken om agents binnen grenzen te houden.

Wat is Claude Security?

Die term wordt vaak op twee manieren door elkaar gebruikt.

De eerste betekenis is de security- en compliancepositie van Anthropic als leverancier. Denk aan SOC 2, ISO 27001, ISO 42001, HIPAA-ready configuraties, het Trust Center, Responsible Scaling Policy, de Transparency Hub, audit logs, retention controls en identity management. Dat is de “kunnen wij dit verantwoord inkopen en beheren?”-kant.

De tweede betekenis is Claude Code Security, het concrete product dat Anthropic in februari 2026 in beperkte research preview beschikbaar maakte voor Team- en Enterprise-klanten en ook voor open-source maintainers. Claude Code Security scant codebases op kwetsbaarheden en stelt gerichte patches voor die door mensen kunnen worden gereviewd. Anthropic positioneert het expliciet als capability voor defenders, niet als offensive tool. In de Mozilla-case liet het bedrijf zien waarom die positionering geloofwaardig is.

Daaronder zit nog een derde laag die eigenlijk minstens zo belangrijk is: hoe veilig is Claude Code zelf? Anthropic documenteert hier onder meer read-only defaults, expliciete approvals, sandboxed bash, write restrictions tot de projectmap, prompt-fatigue mitigatie via allowlists en advies om tegen prompt injection te beschermen. Dat is waardevol, omdat je daarmee kunt zien dat Anthropic security niet alleen als marketinglabel op de buitenkant plakt, maar ook tot in het productontwerp probeert door te trekken.

Voor de geeks: hoe agentic AI van Claude echt werkt

Onder de motorkap werkt Claude agentic niet als een magische alleskunner, maar als een model dat in een agent loop draait: eerst context ophalen, dan een plan vormen, vervolgens tools gebruiken, resultaten teruglezen, opnieuw redeneren en pas daarna de volgende stap zetten. In Claude Code en de Claude Agent SDK is die loop expliciet gemaakt: Claude kan bestanden lezen, code editen, bash-commando’s uitvoeren, het web doorzoeken en via MCP-servers externe tools, databases en API’s aanspreken. MCP is daarbij de integratielaag, een open protocol waarmee je Claude gecontroleerd toegang geeft tot resources en acties. Skills vormen daar weer een lichtere laag bovenop: een SKILL.md met instructies, werkwijze en eventueel commands die Claude automatisch oppakt wanneer relevant. Voeg daar subagents aan toe voor geïsoleerde deeltaken, hooks voor deterministische controles op vaste momenten in de lifecycle, en extended thinking voor complexere redeneerstappen, en je krijgt een systeem dat niet alleen antwoord geeft, maar echt werk orkestreert. Computer use gaat nog een stap verder: dan kijkt Claude letterlijk naar screenshots, beweegt de muis, typt en klikt, zodat het multi-step browser- of desktoptaken kan uitvoeren alsof het een gebruiker is. Voor engineers is dit interessant omdat je hiermee van “help me write code” naar “analyseer deze codebase, draai tests, patch dit probleem en geef me alleen de diff terug” gaat. Voor IT-managers is het interessant omdat precies hier het verschil ontstaat tussen een leuke demo en een echte operationele capability.

Wie dit zelf wil testen, doet er verstandig aan klein en gecontroleerd te beginnen. Laat Claude eerst alleen lezen en analyseren, niet meteen schrijven of uitvoeren. Start bijvoorbeeld in Claude Code Desktop of de CLI op een niet-kritische repo of sandboxmap, koppel hooguit een read-only MCP-server aan bijvoorbeeld documentatie, tickets of een testdatabase, en definieer daarna pas welke tools automatisch mogen draaien. Anthropic ondersteunt hiervoor allow- en deny-rules, permission modes, approval callbacks en hooks, zodat je exact kunt bepalen wat zonder prompt mag en waarvoor expliciete goedkeuring nodig blijft. Een slimme testopzet is vaak: één project, één afgebakende taak, één dataset, zo min mogelijk rechten. Maak vervolgens een kleine Skill voor jullie eigen standaardwerkwijze, zet projectinstructies in CLAUDE.md, en gebruik hooks om verplichte checks af te dwingen, zoals linting, test runs, branch-protectie of blokkades op gevoelige directories. Als je meer autonomie wilt, doe dat dan liever binnen sandboxing met filesystem- en network isolation, juist omdat Anthropic zelf benadrukt dat een prompt-injected agent zonder die grenzen gevoelige bestanden kan uitlezen of data naar buiten kan sturen. Dat is ook precies waarom wij AI governance zo belangrijk vinden: als iedereen los van elkaar thuis of op kantoor met eigen accounts, eigen prompts en eigen connectoren gaat bouwen, ontstaat er snel shadow AI zonder auditability, zonder centrale standaarden en zonder zicht op waar bedrijfsinformatie precies terechtkomt. Experimenteren is goed, maar experimenteren binnen kaders is uiteindelijk wat het verschil maakt tussen nieuwsgierigheid en volwassen inzet.

Wat doen onze partners rondom agentic AI security?

Claude staat natuurlijk niet op zichzelf. Juist nu AI-systemen steeds agentischer worden, zie je dat securityvendors hun eigen positie opnieuw definiëren.

Fortinet positioneert op dit moment FortiAIGate als runtime security gateway voor LLM-workloads en zet op Accelerate 2026 ook in op agentische AI binnen security operations. Dat is relevant voor organisaties die AI niet alleen willen gebruiken, maar ook het modelverkeer, prompt injection-risico en dataverkeer eromheen willen afdekken.

Trend Micro maakt AI-security expliciet tot een eigen discipline. In recente research laat Trend zien hoe documenten AI-gedreven KYC-pijplijnen kunnen misleiden en hoe FENRIR AI-kwetsbaarheden op schaal probeert te vinden. Dat sluit direct aan op de realiteit van Claude, MCP en andere agents: de grootste risico’s zitten vaak niet in “het model zegt iets geks”, maar in de keten van documenten, tools, prompts en acties.

Arctic Wolf positioneert Alpha AI als SOC-intelligence die geavanceerde dreigingen autonoom helpt voorkomen en arbeidsintensieve workflows automatiseert. Voor organisaties die Claude of andere agents inzetten, is dat interessant omdat de vraag verschuift van alleen preventie naar ook observability, triage en response wanneer AI-processen afwijkend gedrag vertonen.

KnowBe4 zet met AIDA Orchestration in op multi-agent human risk management. Dat is relevant omdat elke AI-adoptie uiteindelijk ook een menscomponent heeft. Als medewerkers zelf tools gaan koppelen, data gaan uploaden en prompts gaan delen, dan wordt awareness ineens geen klassiek phishingthema meer maar een AI-governancethema.

Microsoft is tegelijk partner, platform en signaalgever. In Wave 3 van Microsoft 365 Copilot zegt Microsoft expliciet samen te werken met Anthropic en Claude Cowork-technologie in Copilot te hebben ingebracht. Daarnaast schuift Microsoft Agent 365 naar voren als governance- en securitylaag voor enterprise agents. Dat bevestigt voor ons dat de markt snel beweegt van “welk model is slim” naar “hoe besturen en beveiligen we agents in productie”.

Hoe maak je van Claude een onderdeel van je operatie, in plaats van een leuk tooltje?

Dit is uiteindelijk de kernvraag.

De fout die veel organisaties maken, is dat ze te laat schakelen van experiment naar operating model. Eerst krijgt iedereen vrijheid, daarna blijkt dat prompts, documenten, projecten, connectoren en scripts overal verspreid zijn geraakt. Dan moet governance achteraf alsnog orde scheppen.

Wij zouden het liever andersom doen.

Begin met use cases, niet met losse features. Niet “we willen Claude”, maar “we willen beleidswerk versnellen”, “we willen vendoranalyses automatiseren”, “we willen AppSec-capaciteit vergroten”, of “we willen incidentdocumentatie sneller opstellen”.

Kies daarna het juiste inzetniveau. Soms is Claude.ai met Projects en documentgeneratie genoeg. Soms heb je Claude Code nodig. Soms wil je juist alleen API-gebaseerde inzet binnen een eigen app met expliciete tool permissions. En soms wil je Claude helemaal niet direct aan eindgebruikers geven, maar er eerst een afgebakende interne workflow omheen bouwen.

Stel vervolgens governancevragen vroeg:

- welke data mag erin,

- welke teams mogen connectors gebruiken,

- welke tools zijn toegestaan,

- welke MCP-servers vertrouwen we,

- hoe loggen we gebruik,

- hoe borgen we retention,

- wie beheert identity en provisioning,

- en welke use cases mogen alleen in sandbox of lab?

Richt daarna technische guardrails in. Denk aan SSO, SCIM/JIT provisioning, role-based access, audit logs, retentioninstellingen, goedgekeurde connectors, deny rules, hooks, sandboxes en duidelijke scheiding tussen persoonlijke en organisatie-accounts.

En pas dan ga je schalen.

Dat klinkt misschien minder sexy dan “iedereen mag lekker experimenteren”, maar in de praktijk is het precies hoe je voorkomt dat AI binnen een paar maanden verandert in een oncontroleerbare verzameling losse initiatieven.

Onze kijk als Flowerbed

Wij vinden het juist goed als mensen gaan ontdekken wat er allemaal mogelijk is met Claude. Zeker dit weekend zullen veel professionals thuis of op kantoor zelf dingen willen uitproberen. En eerlijk is eerlijk: Claude is ook gewoon een fascinerend platform om mee te spelen. Je kunt er documenten mee laten bouwen, bedrijfskennis structureren, codebases mee onderzoeken, simpele interne tools mee prototypen en zelfs agentische workflows mee opzetten.

Maar precies daarom is centrale regie belangrijk.

Want zodra medewerkers individueel hun eigen toolstack optuigen, hun eigen data ergens in stoppen, hun eigen connectors gaan koppelen en hun eigen promptbibliotheken gaan bouwen, ontstaat een nieuwe vorm van wildgroei. Niet kwaadaardig, vaak juist heel enthousiast, maar wel riskant. Dan krijg je eilandvorming, geen standaarden, onduidelijke dataflows en geen zicht op waar gevoelige informatie landt.

Daarom zijn wij zelf ook volop bezig met alle AI-ontwikkelingen, niet alleen op productniveau maar juist ook op governance-, security- en operationaliseringsniveau. We zien Claude, Copilot, ChatGPT, Gemini en de bredere agentic AI-markt niet als losse hype, maar als iets dat je als organisatie nu serieus moet structureren.

Onze overtuiging is dan ook simpel: wie nu alleen experimenteert zonder governance, bouwt waarschijnlijk technische schuld op. Wie nu experimenteert mét governance, bouwt voorsprong op.

Slot

Claude is in 2026 veel meer dan een slimme chatbot. Het is een AI-platform met sterke modellen, lange context, agentische bouwstenen, coding capabilities, documenttools, open integratiestandaarden en een duidelijke enterprise- en securitypropositie. Dat maakt de hype rond Claude logisch. Niet omdat het magisch is, maar omdat het op meerdere fronten tegelijk volwassen aan het worden is.

Voor organisaties is de belangrijkste vraag daarom niet of Claude interessant is. Dat is het. De echte vraag is hoe je Claude inzet op een manier die efficiëntie oplevert, zonder grip te verliezen op data, identity, compliance en operationele veiligheid.

En precies daar gaan wij graag over in gesprek.

Niet met een standaard demo en ook niet met een hypeverhaal, maar gewoon praktisch: waar zou Claude bij jullie kunnen helpen, welke use cases zijn echt kansrijk, hoe zou je dat veilig kunnen testen, en hoe zorg je dat het beheersbaar blijft als het aanslaat?

Als jullie daar eens over willen sparren met onze consultants, of gewoon samen een paar concrete scenario’s willen verkennen, dan doen we dat graag.

.png)