Start maken?

Deepfake-training met KnowBe4: zo maak je medewerkers weerbaar tegen AI-impersonatie

.png)

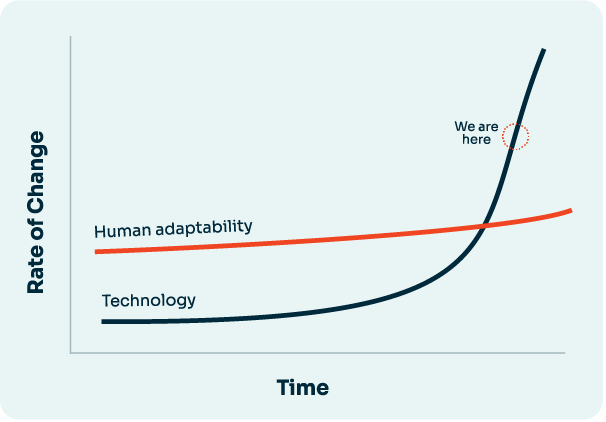

Deepfakes klonken een paar jaar geleden nog als iets uit films en vage internethoekjes. In 2026 zijn ze keiharde realiteit. Video’s en audio waarin een bestuurder, CEO of collega ogenschijnlijk zelf iets zegt, terwijl het in werkelijkheid door AI is gegenereerd. Combineer dat met slimme social engineering en je hebt een nieuw soort aanval waar klassieke awareness-training en ouderwetse phishingmails simpelweg niet meer tegenop kunnen.

Tegelijk zien we dat veel organisaties worstelen met de vraag: hoe trainen we hierop. Je kunt wel vertellen dat deepfakes bestaan, maar pas als mensen het meemaken, klikt het echt. Precies daar speelt de nieuwe deepfake-training van KnowBe4 op in. KnowBe4 biedt nu de mogelijkheid om een volledig gepersonaliseerde deepfake-trainingsvideo te maken met een eigen bestuurder of leidinggevende in de hoofdrol, binnen een strikt gecontroleerde en vooraf gescripte trainingsomgeving.

In plaats van een abstract verhaal over AI-risico’s, krijgen medewerkers een hyperrealistische video te zien die voelt als “iemand van ons”. Dat maakt de impact groot, maar juist omdat alles zorgvuldig is ontworpen als trainingsmoment, blijft het veilig en verantwoord. Het doel is niet shockeren om het shockeren, maar een risicotype dat razendsnel opkomt tastbaar maken en mensen concrete handvatten geven.

Wat is KnowBe4 deepfake-training precies

De deepfake-training van KnowBe4 is een uitbreiding binnen hun bestaande security awareness platform. Organisaties kunnen een herkenbare leider kiezen, bijvoorbeeld een directielid of MT-lid, een korte video en audio aanleveren en op basis daarvan een deepfake-trainingsvideo laten genereren binnen het KnowBe4 platform. Die video volgt altijd een vooraf gedefinieerd script en wordt uitsluitend gebruikt binnen een afgebakende trainingsmodule.

De essentie is dat je de kracht van deepfakes inzet voor het goede. Medewerkers ervaren hoe geloofwaardig AI-impersonatie kan zijn, maar dan in een gecontroleerde setting. Zij leren waar ze op moeten letten in video en audio, welke verificatiestappen verstandig zijn en wat ze moeten doen als “iets net niet helemaal klopt”. De module kan vervolgens worden opgenomen in bestaande awareness-campagnes of als losse high impact training worden ingezet.

Voor organisaties die werken met KnowBe4 Diamond en AIDA (Artificial Intelligence Defense Agents) is dit een logische volgende stap: je had al gepersonaliseerde phishing en AI-gestuurde awareness, nu komen daar realistische deepfake-scenario’s bij die perfect bij de moderne dreigingen passen.

Waarom dit relevant is voor jullie organisatie

De meeste beslissers weten inmiddels dat phishing en social engineering grote risico’s zijn. Maar deepfakes voegen daar iets nieuws aan toe. Het gaat niet meer alleen om een mailtje met een rare link, maar om videovergaderingen, voice-berichten en instructies die rechtstreeks lijken te komen van iemand die je volledig vertrouwt.

Daarom heeft een traditionele awareness-aanpak onvoldoende effect. Medewerkers hebben twee dingen nodig: realistische ervaring met dit type scenario’s en duidelijke, praktische regels. Wanneer moet je twijfelen. Wanneer mag je best even “nee” zeggen tegen een ogenschijnlijk hoge baas. Hoe controleer je of een verzoek echt is, zonder dat je het halve bedrijf stillegt.

Deepfake-training met KnowBe4 helpt om:

- Abstracte AI-risico’s concreet en begrijpelijk te maken.

- Medewerkers te laten voelen hoe overtuigend AI-impersonatie kan zijn.

- Nieuwe “reflexen” aan te leren: checken, verifiëren, melden.

Uit onderzoek en praktijkervaring met security awareness blijkt dat realistische, contextspecifieke trainingen veel hogere betrokkenheid en blijvend gedragseffect opleveren dan generieke modules. Een deepfake van een eigen leider is nu eenmaal moeilijker te negeren dan een willekeurige stockvideo.

Wat levert het concreet op voor jullie als bedrijf:

Voor IT en security:

- Een trainingsvorm die eindelijk aansluit op de actuele dreigingen zoals AI-gestuurde fraude, voice spoofing en deepfake-video.

- Meetbare resultaten: wie herkent de signalen, wie niet, welke afdelingen hebben extra ondersteuning nodig.

- Een krachtig signaal richting bestuur dat je proactief inspeelt op nieuwe risico’s in plaats van alleen achteraf te reageren.

Voor directie en management:

- Een kans om zelf hét voorbeeld te zijn in securitycultuur, door bewust mee te werken aan de training.

- Een moment om de boodschap uit te dragen: “Je mag twijfelen, ook als ik in beeld ben. Veiligheid gaat voor snelheid”.

Voor medewerkers:

- Herkenning: dit lijkt op mijn echte werkcontext.

- Veiligheid: beter inzicht in wat er mis kan gaan en vooral wat zij daaraan kunnen doen.

- Verlichting van angst: zien dat je niet “dom” bent als je twijfelt, maar juist professioneel.

De rol van Flowerbed

KnowBe4 levert de technologie, Flowerbed helpt om er een volwassen programma van te maken. Wij denken mee over:

- De keuze van scenario’s en toon: wat past bij jullie cultuur en risicoprofiel.

- De balans tussen impact en veiligheid: waar ligt voor jullie organisatie de grens.

- De inbedding in een breder human risk programma: phishing simulaties, beleid, meldproces, managementbetrokkenheid.

- Daarnaast bieden wij ook Managed Services: Security Awareness-as-a-Service

Zo wordt deepfake-training geen los trucje, maar een logisch onderdeel van een moderne awareness-strategie.

.png)